La creciente inversión en agentes de IA sugiere un futuro de automatización generalizada, potencialmente aún más transformador que la revolución industrial. Como con cualquier innovación tecnológica, los agentes de IA enfrentarán problemas en su desarrollo. La mejora continua será esencial para el uso responsable y para realizar el potencial completo de los agentes de IA.

En Consensus Hong Kong, BeInCrypto entrevistó a Andrei Grachev, Socio Director de DWF Labs, sobre los desafíos clave que enfrentan los agentes de IA para lograr una adopción masiva y cómo podría ser su uso generalizado.

Los sectores tecnológicos tradicionales y Web3

En este punto, es seguro decir que la adopción de la inteligencia artificial (IA) pronto será inevitable. Gigantes tecnológicos como Meta, Amazon, Alphabet y Microsoft ya han anunciado planes para invertir hasta 320 mil millones de dólares en IA y centros de datos en 2025.

Durante su primera semana en el cargo, el presidente de Estados Unidos, Donald Trump anunció Stargate, una nueva empresa conjunta privada centrada en el desarrollo de centros de datos de IA. La empresa, compuesta por OpenAI, Softbank y Oracle, planea construir hasta 20 grandes centros de datos de IA en todo Estados Unidos.

La inversión inicial se estima en 100 mil millones de dólares, y los planes de expansión podrían llevar el total a 500 mil millones de dólares para 2029. Los proyectos Web 3.0 también están realizando inversiones similares en IA.

En diciembre, DWF Labs, una destacada empresa de capital de riesgo cripto, lanzó un fondo de 20 millones de dólares para agentes de IA para acelerar la innovación en tecnologías autónomas de IA.

A principios de este mes, la Fundación NEAR, que apoya a NEAR Protocol, también anunció su propio fondo de 20 millones de dólares centrado en escalar el desarrollo de agentes completamente autónomos y verificables construidos sobre la tecnología NEAR:

“La historia muestra que todo lo que se puede automatizar se automatizará, y definitivamente algunos procesos comerciales y de la vida normal serán superados por agentes de IA,” dijo Grachev a BeInCrypto.

Pero a medida que el desarrollo de la IA se acelera, el potencial para su uso indebido se convierte en una preocupación creciente.

Uso malicioso de agentes de IA

En Web 3.0, los agentes de IA ya se están convirtiendo rápidamente en algo común. Ofrecen capacidades diversas, desde análisis de mercado hasta trading autónomo de criptomonedas. Sin embargo, su creciente integración también presenta desafíos críticos.

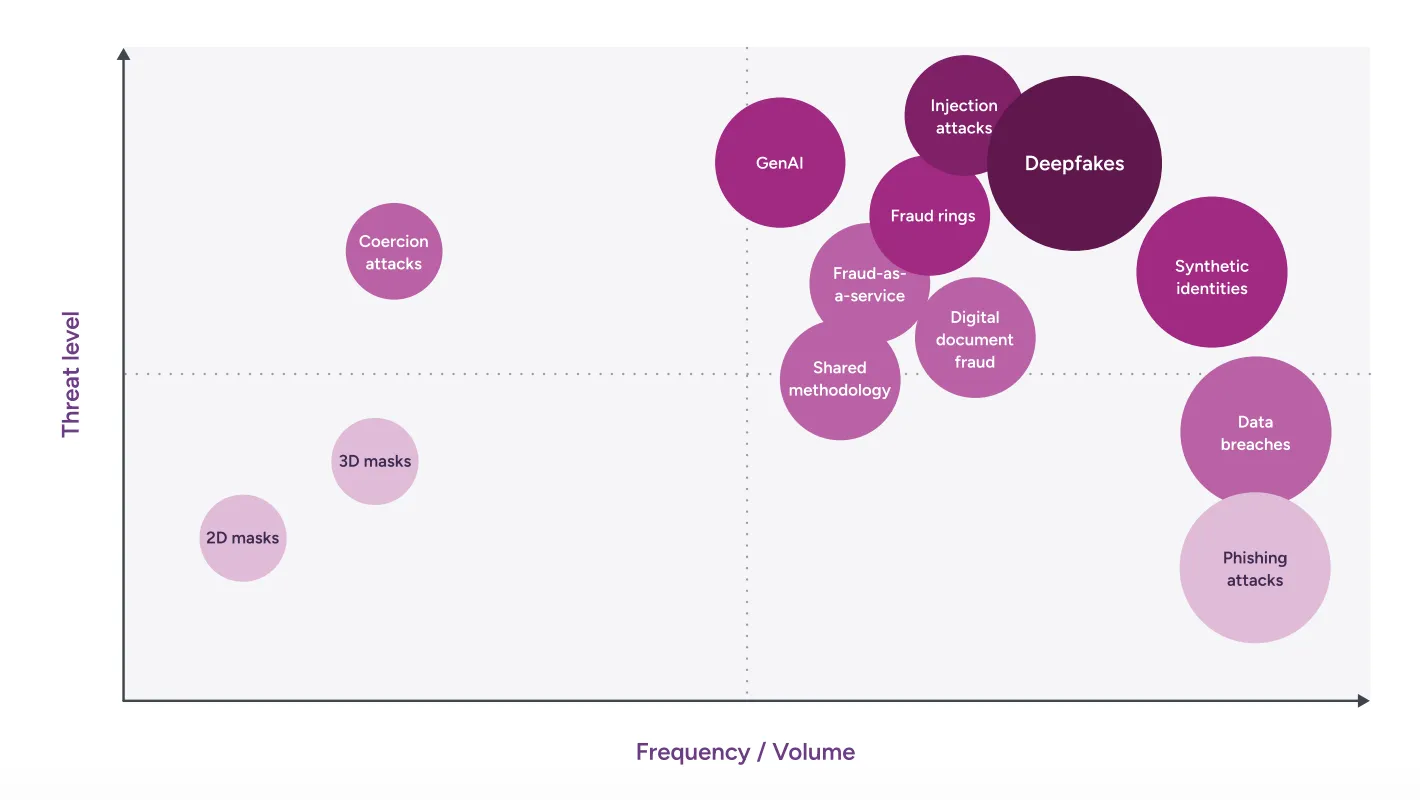

El uso indebido de la IA por actores malintencionados es una gran preocupación, abarcando escenarios que van desde simples campañas de phishing hasta sofisticados ataques de ransomware. La disponibilidad generalizada de la IA generativa desde finales de 2022 ha cambiado fundamentalmente la creación de contenido, al tiempo que atrae a actores malintencionados que buscan explotar la tecnología.

Esta democratización del poder de cómputo ha mejorado las capacidades de los adversarios y potencialmente ha reducido la barrera de entrada para actores de amenazas menos sofisticados.

Según un informe de Entrust, las falsificaciones de documentos digitales facilitadas por herramientas de IA ahora superan a las falsificaciones físicas, con un aumento del 244% interanual en 2024. Mientras tanto, los deepfakes representaron el 40% de todo el fraude biométrico:

“Ya se está utilizando para estafas. Se usa para videollamadas cuando se representa incorrectamente a las personas y se falsifican sus voces,” dijo Grachev.

Ejemplos de este tipo de explotación ya han aparecido en los titulares de noticias. A principios de este mes, un trabajador financiero en una empresa multinacional en Hong Kong fue engañado para autorizar un pago de 25 millones de dólares a estafadores utilizando tecnología deepfake.

El trabajador asistió a una videollamada con individuos que creía que eran colegas, incluido el director financiero de la empresa. A pesar de la vacilación inicial, el trabajador procedió con el pago después de que los otros participantes parecieran y sonaran auténticos, según los informes. Más tarde se descubrió que todos los asistentes eran fabricaciones deepfake.

De la adopción temprana a la aceptación general

Grachev cree que tales usos maliciosos son inevitables. Señala que el desarrollo tecnológico a menudo va acompañado de errores iniciales, que disminuyen a medida que la tecnología madura. Grachev dio dos ejemplos distintos para probar su punto: las primeras etapas de la World Wide Web y Bitcoin:

“Debemos recordar que Internet comenzó con los sitios porno. Fue como el primer Bitcoin, que comenzó con los traficantes de drogas y luego mejoró,” dijo.

Varios informes coinciden con Grachev. Sugieren que la industria del entretenimiento para adultos jugó un papel crucial en la adopción temprana y el desarrollo de Internet. Más allá de proporcionar una base de consumidores, fue pionera en tecnologías como los VCR, la transmisión de video, la realidad virtual y cualquier forma de comunicación.

El porno actuó como una herramienta de incorporación. La industria del entretenimiento para adultos históricamente ha impulsado la adopción de nuevas tecnologías por parte de los consumidores.

Su adopción temprana y aplicación de innovaciones, particularmente cuando satisfacen con éxito las demandas de su audiencia, a menudo conduce a una adopción más amplia en el mercado general:

“Comenzó con diversión, pero la diversión incorporó a muchas personas. Luego puedes construir algo sobre esta audiencia,” dijo Grachev.

Con el tiempo, también se pusieron en marcha garantías para limitar la frecuencia y accesibilidad del entretenimiento para adultos. Sin embargo, sigue siendo uno de los varios servicios que Internet ofrece hoy en día.

El viaje de Bitcoin desde la darknet hasta la disrupción

La evolución de Bitcoin refleja de cerca los primeros casos de uso de Internet. La adopción temprana de Bitcoin estuvo asociada con mercados de la darknet y actividades ilícitas, incluyendo el tráfico de drogas, el fraude y el lavado de dinero. Su naturaleza seudónima y la facilidad de transferencias de fondos globales lo hicieron atractivo para los criminales.

A pesar de su uso continuo en actividades criminales, Bitcoin ha encontrado numerosas aplicaciones legítimas. La tecnología blockchain que sustenta las criptomonedas proporciona soluciones para problemas del mundo real y transforma los sistemas financieros tradicionales.

Aunque todavía son industrias muy incipientes, las aplicaciones de criptomonedas y blockchain seguirán evolucionando. Según Garchev, lo mismo sucederá con el empleo gradual de la tecnología de IA. Para él, los errores deben ser bienvenidos para aprender de ellos y ajustarse en consecuencia:

“Siempre debemos recordar que el fraude ocurre primero y luego la gente comienza a pensar en cómo prevenirlo. Por supuesto, sucederá, pero es un proceso normal, es una curva de aprendizaje”, dijo Grachev.

Sin embargo, saber que estas situaciones ocurrirán en el futuro también plantea preguntas sobre quién debe ser considerado responsable.

Preocupaciones de responsabilidad

Determinar la responsabilidad cuando ocurre un daño debido a las acciones de un agente es un tema legal y ético complejo. La cuestión de cómo responsabilizar a la IA inevitablemente surge. La complejidad de los sistemas de IA crea desafíos para determinar la responsabilidad por daños.

Su naturaleza de “caja negra”, comportamiento impredecible y capacidades de aprendizaje continuo dificultan la aplicación de ideas típicas sobre quién tiene la culpa cuando algo sale mal. Además, la participación de múltiples partes en el desarrollo y despliegue de IA complica las evaluaciones de responsabilidad, lo que dificulta determinar la culpabilidad de los fallos de IA.

La responsabilidad podría recaer en el fabricante por fallos de diseño o producción, en el desarrollador de software por problemas con el código, o en el usuario por no seguir las instrucciones, instalar actualizaciones o mantener la seguridad:

“Creo que todo esto es demasiado nuevo, y creo que deberíamos poder aprender de ello. Deberíamos poder detener algunos agentes de IA si es necesario. Pero desde mi punto de vista, si no hubo una mala intención al crearlo, nadie es responsable porque es algo realmente nuevo”, dijo Grachev a BeInCrypto.

Sin embargo, según él, estas situaciones deben ser gestionadas cuidadosamente para evitar impactar la innovación continua:

“Si culpas a este emprendedor, mataría la innovación porque la gente tendría miedo. Pero si funciona de una mala manera, podría eventualmente funcionar. Necesitamos tener una forma de detenerlo, aprender, mejorar y reaprender”, agregó Grachev.

Sin embargo, la línea fina sigue siendo extremadamente delgada, especialmente en escenarios más extremos.

Abordar problemas de confianza para adopción de IA

Un miedo común al discutir el futuro de la inteligencia artificial concierne a situaciones en las que los agentes de IA se vuelven más poderosos que los humanos:

“Hay muchas películas sobre eso. Si estamos hablando de, digamos, controles policiales o gubernamentales, o algún ejército en algún tipo de guerra, por supuesto, la automatización es como un gran miedo. Algunas cosas pueden ser automatizadas a un nivel tan grande que pueden dañar a los humanos”, dijo Grachev.

Cuando se le preguntó si un escenario como este podría suceder, Grachev dijo que, en teoría, podría. Sin embargo, admitió que no podía saber qué sucedería en el futuro. Sin embargo, situaciones como estas son emblemáticas de los problemas fundamentales de confianza entre los humanos y la inteligencia artificial.

Grachev dice que la mejor manera de abordar este problema es exponiendo a los humanos a casos de uso donde la IA realmente pueda ser útil:

“La IA puede ser difícil de creer para las personas. Por eso debería comenzar con algo simple, porque la confianza en el agente de IA no se construirá cuando alguien explique que es confiable. La gente debería acostumbrarse a usarlo. Por ejemplo, si estás hablando de cripto, puedes lanzar un meme, digamos en Pump.fun, pero ¿por qué no lanzarlo por mensaje de voz? Con agentes de IA, solo envía un mensaje de voz que diga ‘por favor lanza esto y aquello’, y se lanza. Y luego el siguiente paso sería confiar en el agente con algunas decisiones más importantes”, dijo.

En última instancia, el camino hacia la adopción generalizada de la IA estará indudablemente marcado por avances notables y desafíos imprevistos. Equilibrar la innovación con la implementación responsable en este sector en desarrollo será crucial para dar forma a un futuro donde la IA beneficie a toda la humanidad.