La Inteligencia Artificial (IA) vuelve a ser noticia debido a que un grupo de personas, entre ellas Elon Musk y Steve Wozniak, solicitaron pausar al menos 6 meses el entrenamiento de las IA, para que no crezcan como una amenaza a la humanidad.

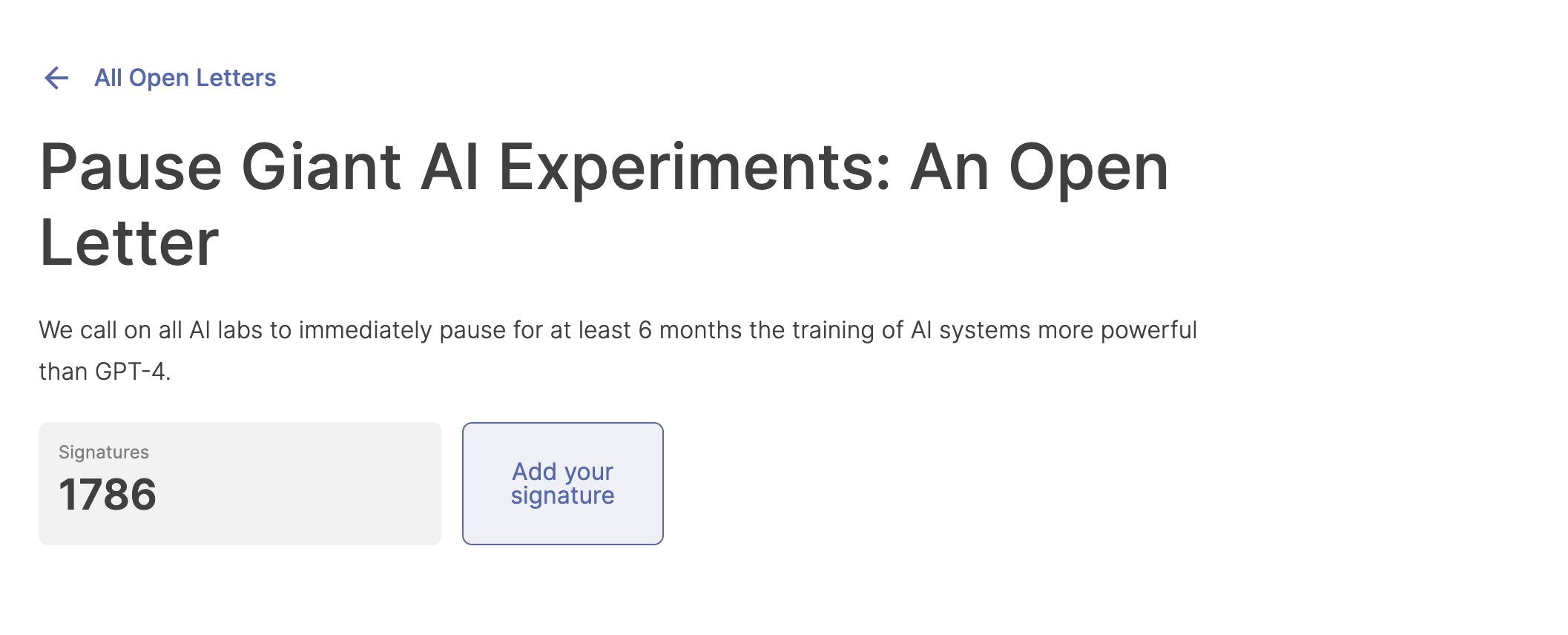

Un grupo de más de 1,000 expertos en Inteligencia Artificial (IA) y personalidades del mundo de la tecnología, firmaron una carta donde solicitan ponerle un freno temporal a esta tendencia. De acuerdo al documento, los sistemas de IA deben desarrollarse solo cuando estemos seguros de que sus efectos serán positivos y sus riesgos serán manejables.

En síntesis, la carta todos los laboratorios de IA que pausen inmediatamente durante al menos 6 meses el entrenamiento de sistemas de IA más potentes que Chat GPT 4.

El documento dejó ver la preocupación existente en la industria, debido a que muchos laboratorios se han dedicado a implementar mentes digitales cada vez más poderosas que nadie, ni siquiera sus creadores, pueden entender, predecir o controlar de manera confiable.

“Esta pausa debe ser pública y verificable, e incluir a todos los actores clave. Si tal pausa no se puede implementar rápidamente, los gobiernos deberían intervenir e instituir una suspensión”

La Inteligencia Artificial podría ser un riesgo para la humanidad

El documento de la carta asegura que el manejo actual que se le está dando a las plataformas de IA puede representar profundos riesgos para la sociedad y la humanidad.

Además de Elon Musk y Steve Wozniak, la carta fue firmada por algunos ingenieros de Meta y Google, el fundador y director ejecutivo de Stability AI, Emad Mostaque, y personas que no están en tecnología. Incluso, el equipo detrás del modelo de lenguaje grande GPT-4, también firmó esta carta.

Pero eso no es todo. La misma empresa OpenAI, que está detrás de GPT-4, advirtió recientemente sobre los potenciales riesgos que representa esta la tecnología.

“Una superinteligencia desalineada podría causar un daño grave al mundo; un régimen autocrático con una superinteligencia decisiva podría hacer eso también”,

Preocupación por el riesgo que representa para algunos empleos

Uno de los temas más relevantes relacionados con la IA en los últimos días es la preocupación que existe entre diferentes industrias que plantean que estas tecnologías pueden llegar a reemplazar diferentes tipos de roles. Incluso, desde BeInCrypto reportamos que la inteligencia artificial afectará 300 millones de puestos laborales, según Goldman Sachs.

Según el reporte, las funciones administrativas y las legales son las que, en este escenario, presentan mayores riesgos frente al avance tecnológico.