El Tribunal Supremo británico ha dictaminado que una máquina de inteligencia artificial (IA) llamada DABUS no puede figurar como inventora en el listado de la legislación británica sobre patentes. La sentencia se produce después de que su creador, Stephen Thaler, intentara conseguir una patente para un envase de bebidas y una luz intermitente que creó, mientras aumenta la preocupación por las implicaciones de la IA general (IAG) para los seres humanos.

El máximo tribunal británico dictaminó que “DABUS no es una persona en absoluto”, desestimando el recurso de Thaler. Sin embargo, el tribunal aclara que la sentencia no hace que otras invenciones de IA cada vez más avanzadas no puedan ser patentadas.

Tribunal británico se pronuncia contra la autoría de la IA

El abogado del gobierno dijo que admitir el recurso de Thaler podría permitir que en el futuro se listara como inventor algo arbitrario. Thaler se listó a sí mismo como titular de la patente, pero DABUS era el inventor. Los abogados de Thaler dijeron que la sentencia desalentaría la innovación.

“[La] política de prohibir la concesión de patentes para invenciones generadas por IA desincentiva enormemente la innovación”.

Los tribunales de Australia y Europa tampoco permitieron a Thaler listar a DABUS como inventor. Sudáfrica fue el único país que permitió a Thaler hacer constar a DABUS como inventor.

Leer más: 9 acciones de inteligencia artificial: ¿Cuál comprar en 2023?

La decisión del Reino Unido sigue la de la Oficina de Derechos de Autor de Estados Unidos en relación con la autoría humana. El departamento gubernamental estadounidense afirmó que los contenidos creados sin aportación humana no pueden ser protegidos por la ley de derechos de autor.

Por su parte, la Academia de la Grabación afirma que sólo las obras en cuya creación haya intervenido el ser humano pueden optar a un premio Grammy. La declaración de su jefe, Harvey Mason Jr., se produjo después de que las canciones creadas por IA con voces o música de artistas destacados crearan una zona gris para las nominaciones a los Grammy.

IA: ¿Cómo abordarán las leyes británicas las cuestiones inmediatas?

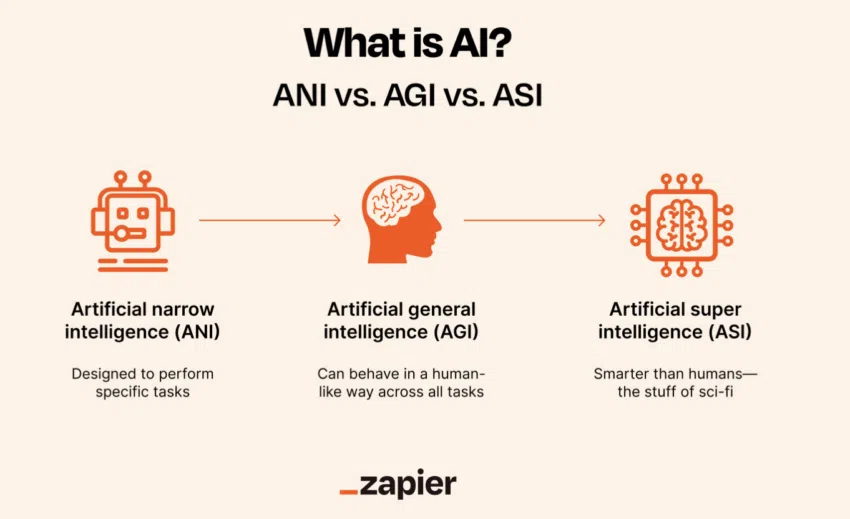

El caso de Thaler plantea cuestiones complejas sobre el avance de la IA hacia los dominios de la inteligencia general artificial (AGI). Los estatutos de OpenAI definen vagamente la AGI como la tecnología de IA que podría poseer un intelecto preparado para un trabajo económicamente valioso.

El Brookings Institute sugiere que la IA no tiene la destreza manual necesaria para los trabajos comunes en Estados Unidos. Esta limitación significa que la inteligencia artificial aún está lejos de sustituir por completo a los humanos. Los críticos del modelo GPT-4 de OpenAI dicen que la gente no debería confundir el rendimiento de la IA con la competencia.

Leer más: Bard: Una guía sobre el chatbot inteligente de Google

Sin embargo, es posible que los tribunales pronto tengan que prepararse para más casos como el de Thaler, puesto que la herramienta Bard de Google ya puede crear código, algo que tradicionalmente han hecho los humanos. El código suele ser propiedad intelectual del desarrollador de software o de su empleador.

Si las leyes no consideran a la IA un inventor, no queda claro quién es responsable de un mal funcionamiento catastrófico. La reciente incursión de EY en el uso de IA para investigar fraudes planteó dudas sobre la capacidad de la tecnología para detectar distintos tipos de fraude. Si la herramienta, por ejemplo, falla en algo, no está claro a quién culpar.

¿Tiene algo que decir sobre la IA cualquier otro tema? Escríbanos o únase a la discusión en nuestro canal de Telegram. También puede encontrarnos en Facebook o X (Twitter).