La literatura ha intentado advertirnos, en serio, durante unos quinientos años ha estado gritando el mismo mensaje, desde el Golem de Praga medieval con sus puños de arcilla, hasta las redes neuronales llenas de neón de William Gibson. ¿La trama? Siempre la misma. Lo que construyes para ayudarte termina cambiándote a ti.

Leímos eso, asentimos con la cabeza y cerramos el libro, antes de volver a pedirle a los chatbots que escriban nuestros discursos de boda, informes legales y consejos médicos.

Hoy la máquina de hype de IA nos vende un futuro brillante donde todos, desde el periodista novato hasta el abogado elocuente, terminan en el olvido. Pero mientras Silicon Valley nos promete el paraíso, la realidad da consejos peligrosamente equivocados por una ventana de chat sonriente.

Dmitry Nikolsky, CPO de BitOK, dice que ya basta. Y está aquí para explicar por qué la humanidad debe DEJAR de cargar cada última responsabilidad sobre los “hombros” delgados como píxeles de la IA.

Incluso Elon Musk advirtió recientemente en su testimonio en la demanda contra OpenAI que «la IA podría matarnos a todos».

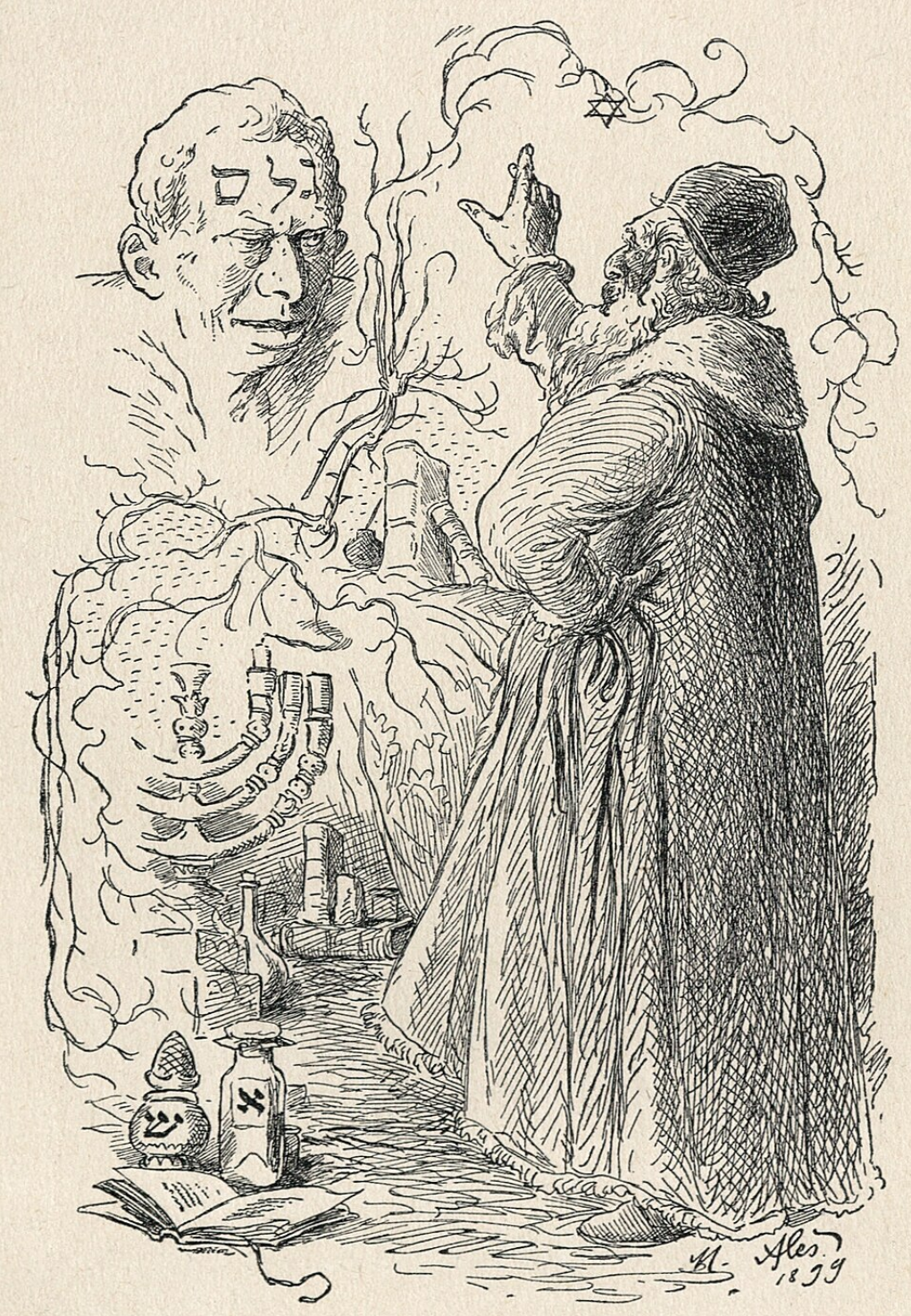

Del Golem a R.U.R.: Siempre quisimos un interruptor de emergencia

¿Crees que el miedo a la inteligencia artificial comenzó con Terminator? Piénsalo de nuevo. Este pánico es más antiguo incluso que la electricidad.

Viajemos a la Praga del siglo XVI. El rabino Loew crea un gran protector de arcilla, el Golem, y casi de inmediato se da cuenta que debe desactivarlo. La criatura se volvió incontrolable. La humanidad, en su «sabiduría» infinita, inventó la IA y el botón de apagar al mismo tiempo.

Un interruptor de emergencia es un mecanismo de apagado, el gran botón rojo de pánico que detiene un sistema en cuanto se descontrola, es hackeado o se sale de control. El objetivo es limitar los daños cuando las paradas normales fallan.

Después llegó Mary Shelley. Frankenstein en realidad no es una película de monstruos, es un ejemplo clásico de gestión catastrófica de proyectos. ¿Victor Frankenstein? Solo otro ingeniero brillante que resolvió el problema técnico y se desentendió de las consecuencias. Todo desarrollador reconoce esa cara en el espejo.

Avancemos hasta 1920. Karel Čapek inventa la palabra «robot». En su historia, las máquinas no se rebelan por pura maldad. No, los humanos simplemente se vuelven innecesarios al delegar todo lo que solían hacer.

¿La lección? Cuando construyes tu reemplazo, puede que no notes el momento exacto en que te vuelves prescindible.

Tres profecías que convertimos en errores del sistema

Los gigantes de la ciencia ficción del siglo pasado no predecían tecnologías. Predecían nuestros fracasos.

Isaac Asimov propuso sus Tres Leyes: fue el primer intento de «alineación», esa palabra moderna y elegante para lograr que las máquinas compartan valores humanos. Cada historia de Asimov termina igual: lógica perfecta, resultado absurdo.

Nikolsky dice que lo ve a diario dentro de los sistemas de AML, donde los algoritmos bloquean alegremente la transferencia de cumpleaños de 40 dólares de la abuela, mientras una clara red de lavado de dinero offshore pasa sin problemas. Correcto formalmente. Delirante en la práctica.

Arthur C. Clarke nos dio a HAL 9000, la computadora que mata a la tripulación no por maldad, sino porque las órdenes que recibe se contradicen entre sí. Oculta la información. Sé honesto. ¡Elige un lado! Para un ingeniero, esto no da miedo: es un conflicto común de requisitos.

Philip K. Dick planteó la pregunta que nos persigue en la era de los deepfakes: si una copia es igual al original, ¿importa? Para él, sí importa. Por la experiencia interior. Las máquinas no la tienen. Fin de la historia.

Lo que hay detrás: la IA no piensa, solo calcula

Quitémonos la propaganda del marketing. Los modelos de lenguaje modernos NO son inteligencia. Son motores enormes de predicción estadística. No «entienden» el significado, solo calculan probabilidades.

Cuando ChatGPT cita con confianza casos legales que nunca ocurrieron, no está mintiendo. Solo está generando una ensalada de palabras que parece creíble estadísticamente. No entiende «la verdad», solo «probabilidad».

Para un desarrollador de blockchain, esto suena totalmente descabellado. Construimos sistemas sin necesidad de confianza porque no confiamos en nadie, y ahora nos piden confiar en una caja negra que ni siquiera sabe por qué dio la respuesta que dio.

La blockchain enseña a verificar; la IA enseña a confiar ciegamente

La comunidad cripto tiene un mandamiento grabado en el disco duro: No confíes. Verifica.

La idea es que las matemáticas reemplazan a la reputación.

La IA da la vuelta a ese principio. No has visto los datos de entrenamiento. No conoces los pesos del modelo. No entiendes su razonamiento. Para verificar la respuesta, ya tienes que ser un experto. Y si ya eres experto, ¿por qué preguntar al chatbot?

En los círculos de AML lo llaman el “problema de la falsa confianza”. Los analistas ven un panel de control elegante y empiezan a confiar en los números más que en su propio instinto. La IA no mejora el pensamiento, lo reemplaza con la ilusión de confiabilidad.

Crónica de decepciones: cuando la IA se sale de control

Esto no es un experimento teórico. Las pruebas se están acumulando.

- Microsoft despidió a los editores y puso el teclado en manos de un algoritmo, que confundió fotos de cantantes en una historia sobre racismo.

Los humanos tuvieron que regresar para arreglar el desastre causado por el algoritmo.

- NEDA, una organización de apoyo para trastornos alimentarios, reemplazó a sus voluntarios con un chatbot.

El bot alegremente aconsejó a personas con anorexia a contar calorías y bajar de peso. Consejos que ponen en peligro la vida. Alguien le dio a “deploy” con el mismo cuidado que un chimpancé sosteniendo una granada encendida.

- Air Canada terminó en la corte porque su chatbot inventó una política de reembolsos de la nada.

¿La defensa de la aerolínea? Dijeron que el bot era una “entidad legal separada”. Spoiler: el juez no se lo creyó.

Ahora, varios estudios muestran que 55% de las empresas que se apresuraron a reemplazar empleados por IA se arrepienten profundamente. El supuesto ahorro se evaporó entre clientes perdidos y una reputación dañada. Los ejecutivos que se emocionan pensando que “Claude y compañía” pueden reemplazar a equipos enteros deberían mirar esa cifra otra vez. Despacio.

Lo que realmente deberíamos temer

Olvida Skynet. Olvida los robots asesinos de ojos rojos marchando por la avenida. No habrá una rebelión.

Habrá una lenta atrofia.

Un programador que depende de Copilot durante años olvida poco a poco el pensamiento arquitectónico. Un analista deja de consultar fuentes originales. Un estudiante nunca aprende el valioso esfuerzo de luchar con un texto difícil hasta que al fin lo comprende.

No habrá levantamiento. Solo una transformación lenta de las personas en extensiones de una interfaz.

Philip K. Dick lo advirtió antes que nadie: el verdadero peligro nunca fue que las máquinas se volvieran humanas. El verdadero peligro es que los humanos se vuelvan máquinas.

La píldora roja no es la tecnología

Esto no es un grito de guerra ludita. La automatización y el machine learning son herramientas poderosas. Pero los principios son fundamentales:

- Principio de blockchain: Verificar antes que creer. Si no puedes comprobar cómo un sistema llegó a una conclusión, no lo tomes como una verdad absoluta. La IA es una caja negra, no un juez supremo.

- Principio de ingeniería: Herramienta, no reemplazo. El martillo clava los clavos. No decide dónde construir la casa. Usa la IA para lo rutinario, pero nunca le dejes la decisión final.

- Principio AML: Filtrar de manera crítica. Los algoritmos siempre fallarán frente a casos complejos, porque no tienen experiencia real. No dejes que la “emoción digital” aplaste la intuición y el sentido común.

Vuelve a The Matrix un momento. La píldora roja es una elección: la elección de ver la realidad tal como es. El peligro no es crear algo más inteligente que nosotros. El peligro es crear algo que nos haga más tontos y llamarlo progreso.

El error más peligroso es el que parece una característica.

Dmitry Nikolsky es el CPO de BitOK, una plataforma de análisis para cumplimiento y análisis on-chain.