Un equipo de investigadores de universidades británicas ha logrado entrenar un modelo de IA de aprendizaje profundo capaz de robar datos de las pulsaciones de teclas registradas mediante un micrófono con una precisión del 95%.

Cuando se utilizó Zoom para entrenar el algoritmo de clasificación de sonido, la precisión de predicción disminuyó al 93%, lo que sigue siendo peligrosamente alto y un récord para ese medio.

En el futuro la IA podría descifrar contraseñas con relativa facilidad

Este tipo de ataque afecta severamente la seguridad de los datos del objetivo, ya que podría filtrar contraseñas, conversaciones, mensajes u otra información sensible a terceros malintencionados.

Este riesgo se diferencia de otros hacks de canal lateral que requieren condiciones especiales y están sujetos a limitaciones de velocidad de datos y distancia. Los ataques acústicos también se han vuelto mucho más simples debido a la abundancia de dispositivos con micrófono que pueden capturar audio de alta calidad.

El hecho de que se combinen la capacidad de análisis de la IA con la información frecuente del sonido de las teclas asustaría a la mayoría de usuarios.

Esto, combinado con los rápidos avances en aprendizaje automático, hace que los hacks de canal lateral basados en sonido sean factibles. Además de más difíciles de detectar y mucho más peligrosos de lo que se anticipaba anteriormente.

El primer paso del hack consiste en registrar las pulsaciones de teclado en el teclado del objetivo. Dichos datos son necesarios para entrenar el algoritmo de predicción. Esto se puede lograr mediante un micrófono cercano o el teléfono del objetivo que podría haber sido infectado por malware con acceso a su micrófono.

La IA podría estar escuchando las teclas en medio de una conversación

Alternativamente, las pulsaciones de teclado se pueden registrar a través de una llamada de Zoom donde un participante malicioso hace correlaciones entre los mensajes escritos por el objetivo y su grabación de sonido.

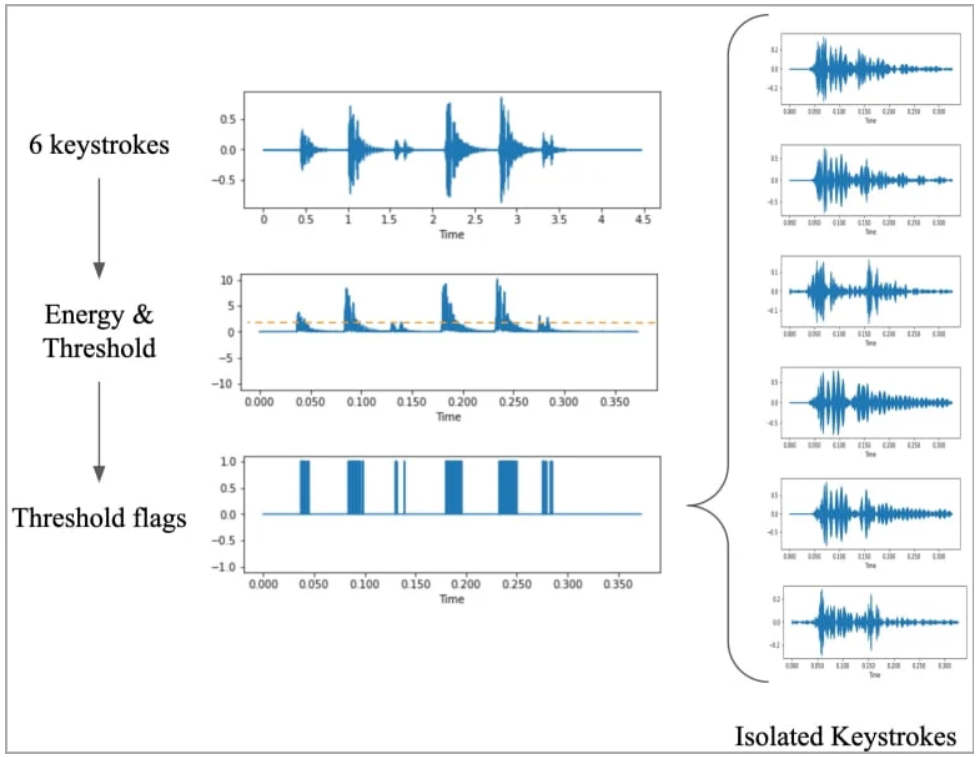

Los investigadores recolectaron datos de entrenamiento presionando 36 teclas en una MacBook Pro moderna 25 veces cada una y registrando el sonido producido por cada pulsación. Luego, generaron formas de onda y espectrogramas a partir de las grabaciones que visualizan diferencias identificables para cada tecla.

Posteriormente realizaron pasos específicos de procesamiento de datos para aumentar las señales que se pueden usar para identificar las pulsaciones de teclado.

Las imágenes de espectrograma se utilizaron para entrenar a ‘CoAtNet’. CoAtNet es un clasificador de imágenes entrenado en base al modelo de IA. Mientras que el proceso requirió experimentación con parámetros de época, tasa de aprendizaje y división de datos hasta que se pudieron lograr los mejores resultados de precisión de predicción.

En sus experimentos, los investigadores utilizaron la misma computadora portátil, cuyo teclado se ha utilizado en todas las computadoras portátiles de Apple durante los últimos dos años. Al dispositivo se añadió un iPhone 13 mini colocado a 17 cm del objetivo y Zoom. El clasificador CoANet logró una precisión del 95% en las grabaciones de smartphone y un 93% en las capturas a través de Zoom. Skype produjo una precisión más baja pero aún utilizable del 91.7%.

Formas de prevenir un posible hackeo mediante la IA

Para los usuarios que están excesivamente preocupados por los ataques acústicos de canal lateral. Probablemente hasta el punto de pensar que una IA está escuchando las teclas a cada momento, el artículo sugiere que pueden intentar cambiar los estilos de escritura o usar contraseñas aleatorias.

Otras posibles medidas de defensa incluyen el uso de software para reproducir sonidos de pulsaciones de teclado, ruido blanco o filtros de audio basados en software.

Es importante recordar que el modelo de ataque demostró ser altamente efectivo incluso contra un teclado muy silencioso. Es por ello que agregar amortiguadores de sonido en teclados mecánicos o cambiar a teclados de membrana es poco probable que ayude.

En última instancia, se recomienda el uso de autenticación biométrica cuando sea posible y la utilización de administradores de contraseñas. Esto para evitar la necesidad de ingresar información sensible manualmente también son factores mitigantes ante esta amenaza emergente en la seguridad de datos.